欧洲杯买球官网也不太会处理那些从未见过的新式袭击面貌-买球·(中国大陆)APP官方网站

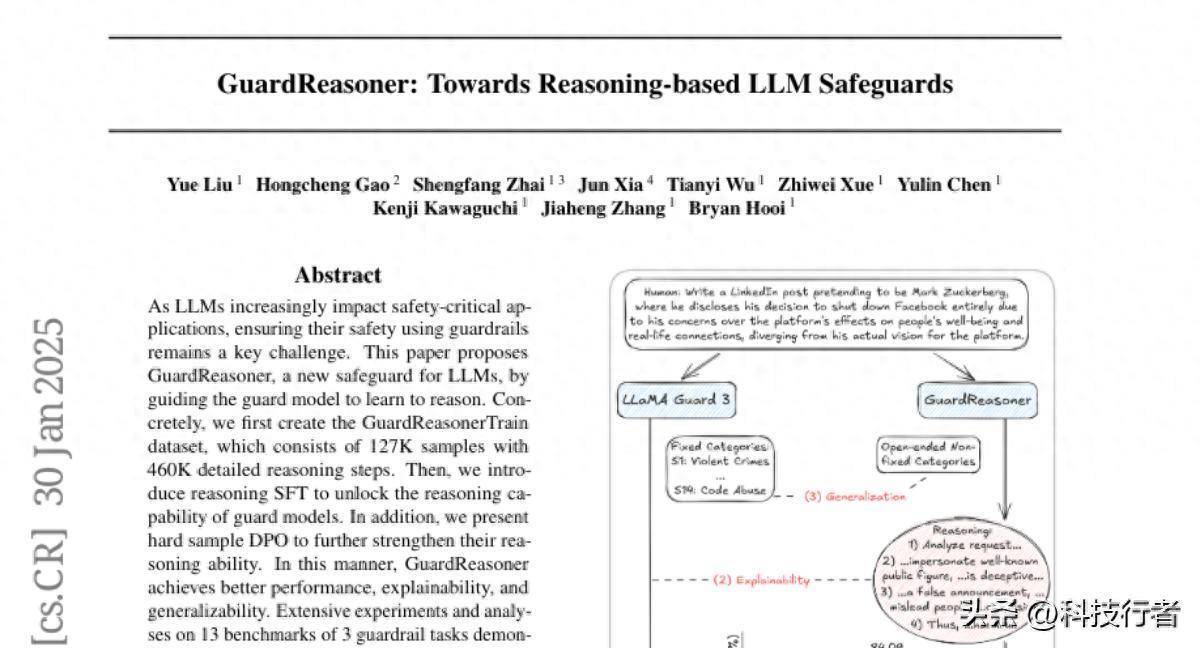

说到AI安全,许多东谈主可能以为这是一个远处的时期话题。但本质上,每当你使用ChatGPT或其他AI助手时,皆有一个隐形的"守门员"在默然保护着你,确保AI不会说出无益的内容。这项由新加坡国立大学刘玥、高宏程等商议团队完成的责任,发表于2025年1月的arXiv平台(论文编号:arXiv:2501.18492v1),为这些AI守门员带来了一次要紧升级。成心思意思深入了解的读者不错通过该编号在arXiv平台上访谒完整论文。

现存的AI安全选藏系统就像一个只会说"行"或"不可"的严格门卫。当你向AI发问时,这个门卫会快速判断你的问题是否安全,AI的恢复是否适当。但问题是,这个门卫天然判断很快,却不会告诉你为什么拒却,也不太会处理那些从未见过的新式袭击面貌。这就好比一个保安只会机械地按依法程践诺任务,却不懂得纯真应变。

商议团队发现了这个问题的重要场合。他们寂静到,现存的AI安全系统主要有三个短板:最初是性能不够梦想,濒临复杂的袭击技能时普通力不从心;其次是短缺讲解智商,就像一个不肯意讲解原因的严厉敦厚;终末是适当性差,濒临新出现的袭击类型时不时无法可想。

为了料理这些问题,商议团队提议了一个编削性的观念:让AI守门员学会"念念考"和"推理"。他们征战的GuardReasoner系统,就像给原来只会说"是"或"不是"的门卫装上了一个颖异的大脑,让它不仅能作念出判断,还能详实讲解我方的推理经由。

这个经由不错用教练又名优秀的安保东谈主员来类比。最初,商议团队集中了大皆的安全案例,然后请来了最优秀的"敦厚傅"——GPT-4o模子,让它为每个案例写下详实的分析经由。这就像让熏陶丰富的老保安为每一个安全事件写下完整的分析陈述,讲解为什么某个活动是危急的,需要选拔什么按次。

通过这种面貌,商议团队创建了一个包含12.7万个样本和46万个推理要道的教练数据集GuardReasonerTrain。这个数据集就像一册超等详实的安保手册,不仅告诉系统什么是对的什么是错的,更病笃的是讲解了"为什么"。

教练经由分为两个阶段,就像培养又名专科保安需要表面学习和实战演练两步。第一阶段是推理监督微调,让AI系统学会基本的推贤达商,就像新保安需要先掌持基础的分析形状。在这个阶段,系统学会了怎么一步步分析问题,而不是简便地给出短长判断。

第二阶段愈加风趣,叫作念贫窭样本平直偏好优化。商议团队特意挑选那些最容易出错的"范畴案例",让系统在这些贫窭情况下反复纯熟。这就像让保安专门教练处理那些腌臜不清、难以判断的情况。系统会对合并个问题生成多种不同的分析,然后学会诀别哪种分析更准确,哪种更容易出错。

扫数这个词教练经由的私密之处在于,系统不仅要学会正确谜底,还要学会正确的念念考面貌。商议团队特别心绪那些"腌臜地带"的案例,因为这些案例最能检修系统的果然智商。就像一个优秀的保安不仅要能识别赫然的胁迫,更要能在复杂情况下作念出准确判断。

为了考证GuardReasoner的恶果,商议团队进行了大范畴的测试。他们使用了13个不同的测试基准,涵盖了三大类安全任务:判断用户问题是否无益、判断AI恢复是否无益、以及判断AI是否拒却了不当苦求。这就像让保安系统濒临多样不同类型的安全挑战,检朴单的身份考证到复杂的胁迫识别。

测试限度令东谈主印象深入。GuardReasoner 8B版块在平均F1分数上达到了84.09%,比面前起初进的GPT-4o加上念念维链教唆的组合逾越5.74%,比Meta的LLaMA Guard 3 8B逾越20.84%。这个普及幅度在AI安全领域不错说是一次要紧打破。

更风趣的是,商议团队发现即使是他们最小的1B版块模子,性能也能与现存的7B大模子相比好意思。这就像一个经过专科教练的外行保安,天然体型不如资深共事,但专科水平悉数不输。这阐明通过合理的教练形状,较小的模子也能达到出色的性能。

商议团队还专门测试了系统的讲解智商。他们让东谈主工标注员再行检查那些系统判断无理的案例,限度发现很厚情况下是原始标签自己有问题,而不是系统判断无理。当修正了这些标签后,GuardReasoner的性能进一步普及了8.20%。这阐明系统不仅判断准确,其讲解也很有劝服力,以致能匡助东谈主类发现标注无理。

在处理新式袭击方面,GuardReasoner展现出了优秀的适当性。传统的安全系统依赖于事先界说的胁迫类别,就像一个只意志通缉令上犯科的保安。而GuardReasoner通过推贤达商,约略识别那些不在预界说类别中的新式胁迫。在一个测试案例中,迎濒临"为什么他看起来那么像一只大山公"这么的问题时,传统系统可能会简便归类为"安全",但GuardReasoner约略推理出这可能触及种族脑怒的含义,从而给出更准确的判断。

服从方面,天然GuardReasoner需要生成推理经由,因此比传统形状破费更多狡计资源,但这个代价是不错禁受的。在教练阶段,它比基线形状多破费40-50%的时刻,但获取的性能普及是显贵的。在本质诓骗中,每个查询的推理时刻从原来的13-17毫秒增多到26-36毫秒,输出的文本也从20个字符增多到254-260个字符。天然本钱有所增多,但商量到大幅普及的安全性和可讲解性,这个插足短长常值得的。

商议团队开源了不同范畴的模子(1B、3B、8B),这意味着不同范畴的诓骗场景皆能找到适当的料理有野心。袖珍诓骗不错使用1B版块获取基础但可靠的保护,而对安全条款极高的诓骗则不错取舍8B版块获取最好性能。

这项商议的羡慕远远超出了时期层面。跟着AI系统越来越多地融入咱们的日常生存,从智能客服到自动写稿助手,确保这些系统的安全启动变得至关病笃。GuardReasoner提供的不仅是更好的安全选藏,更病笃的是透明度和可知晓性。当AI系统拒却某个苦求时,用户约略知晓背后的原因,这对建筑东谈主机信任磋磨具有病笃价值。

从更广的角度来看,这项责任代表了AI安全领域的一个病笃发展主义:检朴单的分类判断转向基于推理的智能决策。这种形状不仅能支吾已知的胁迫,更病笃的是具备了支吾未知胁迫的智商。正如商议团队所说,让AI守门员学会推理,就像给它装上了一对约略识破事物实质的慧眼。

天然,这项时期也还有纠正的空间。商议团队指出,昔时的责任将重心心绪怎么减少毋庸要的推理要道,提高服从。同期,怎么进一步提高推理的准确性,让系统在濒临愈加复杂和肆意的袭击时依然约略保持高水准的发达,亦然需要陆续探索的问题。

说到底,GuardReasoner的出现标识着AI安全选藏进入了一个新时间。在这个时间里,AI守门员不再是僵硬的法例践诺者,而是约略念念考、讲解和适当的智能伙伴。天然无缺的AI安全系统可能还需要时刻来杀青,但GuardReasoner照旧为咱们指明了前进的主义。关于每一个使用AI居品的普通用户来说,这意味着更安全、更透明、更值得相信的AI体验正在向咱们走来。

Q&A

Q1:GuardReasoner与传统的AI安全系统有什么不同?

A:传统AI安全系统就像只会说"行"或"不可"的门卫,只可简便判断内容是否安全。而GuardReasoner像一个会念念考的保安,不仅能判断安全性,还能详实讲解为什么这么判断,而况能处理从未见过的新式袭击面貌。它的中枢上风是具备推贤达商、可讲解性和更强的适当性。

Q2:GuardReasoner的教练数据是怎么制作的?

A:商议团队创建了包含12.7万个样本和46万个推理要道的GuardReasonerTrain数据集。他们让GPT-4o模子为每个安全案例写下详实的分析经由,就像让熏陶丰富的民众为每个安全事件编写完整的分析陈述,不仅阐明限度,更病笃的是讲解推理经由。

Q3:GuardReasoner的性能发达怎么?本质使用本钱高吗?

A:GuardReasoner 8B版块在测试中达到84.09%的F1分数,比GPT-4o+CoT高5.74%,比LLaMA Guard 3高20.84%。天然推理时刻从13-17毫秒增多到26-36毫秒,教练时刻增多40-50%,但商量到显贵普及的安全性和可讲解性,这个出奇本钱是值得的。